最近、SNSで「片山さつき財務相が中国国債の新規購入を無期限停止し、その規模は7兆円」という“完全なデマ”が拡散されました。実際には会見も発表も一切存在せず、元ネタはAIが作り出した“もっともらしい噓の文章”のようです。特に今回のケースは、日中間の対立を煽る表現が用いられたことで拡散が加速しました。

AIが作った噓がSNSで増幅され、あたかも事実であるかのように扱われ、投稿者のリスクさえ考慮する必要があります。本稿では、この具体例をもとに、AI発のデマとSNSの拡散力が生む危険性を分かりやすく解説します。

🤔 AIは“もっともらしい噓”を作り出す

AIはとても便利ですが、「これは本当?」と判断してくれるわけではありません。政治家の名前、数字、日付などをそれっぽく並べることで、あたかも本物のニュースのような文章を作ることがあります。

今回のデマもその典型です。内容は、

- 2025年11月14日

- 片山さつき財務大臣が発表

- 中国の人民元建て国債の新規購入を無期限で停止

- 対象規模は約7兆円(約500億人民元)

- 既存の保有分はそのまま

という“完璧に作られた噓の物語”。

しかし、実際にはこの発表は存在しません。会見記録もゼロ、報道もゼロ。数字も時期も完全に捏造です。

AIは、例えば麻生財務相が「日本は中国国債を買っていない」と説明した過去のニュースなどを混ぜ合わせ、勝手に“それっぽいストーリー”を再構成してしまうことがあります。人間が読むと本物のニュースに見えるため、さらに危険です。

😵 SNSはデマが爆発的に広がる

SNSは「怒り」「驚き」「危機感」を与える情報ほど拡散しやすい構造になっています。だから、AIが作った噓であっても、刺激が強ければ一気に広がります。

特に今回のように、日中の対立を煽るような内容は拡散されやすい傾向があります。国と国の関係にかかわる話題は人々の感情に強く影響し、「日本が中国に強く出た」「中国が怒っている」「対立が激しくなる」 といった“緊張を刺激するストーリー”は、事実かどうかに関係なく注目されてしまうからです。

さらに厄介なのは、“デマを見た別のAIが、その投稿を“事実の証拠”として扱ってしまうことがある”という点です。

こうしてAI同士が噓を補強しあい、噓 → SNSで拡散 → AIが引用 → より精密な噓へ進化という無限ループが生まれます。

一度大きく広がったデマは、誰にも止められなくなり、訂正されても“炎上だけが残る”というケースも珍しくありません。

😫 デマを拡散した人のリスク

多くの場合、噓を広めた本人に悪意はありません。ただ、「本当だと思った」「みんなも言っていたから」という理由で拡散しただけです。しかし、結果として、SNSで大量の批判、アカウント停止、信用失墜、noteやブログの炎上 など、深刻なダメージを受ける可能性があります。

さらに今回のような“国際的な話題”や“金融関連の情報”の場合、影響はより大きく、誤報によって次のようなリスクが生まれます。

- 取引市場で誤った判断がされ、投資家が実害を受ける

- 外交問題として他国に誤解を与える

- 円相場・株価・国債市場などに無用な混乱を引き起こす

- 海外メディアが誤って引用し、日本発のデマが国際ニュースとして流れる危険

つまり、デマが“国の信用”や“金融市場の安定”にまで影響する可能性があるのです。ほとんどは“確認不足”が原因ですが、それでも責任を問われてしまうのがSNSの世界です。

😟 まとめ:理解できない情報は投稿しない

AIは役に立ちますが、使い方を間違えると「もっともらしい噓」が一瞬で広まり、無関係な人まで巻き込みます。そしてデマを信じた人自身が炎上の中心に立たされることもあります。

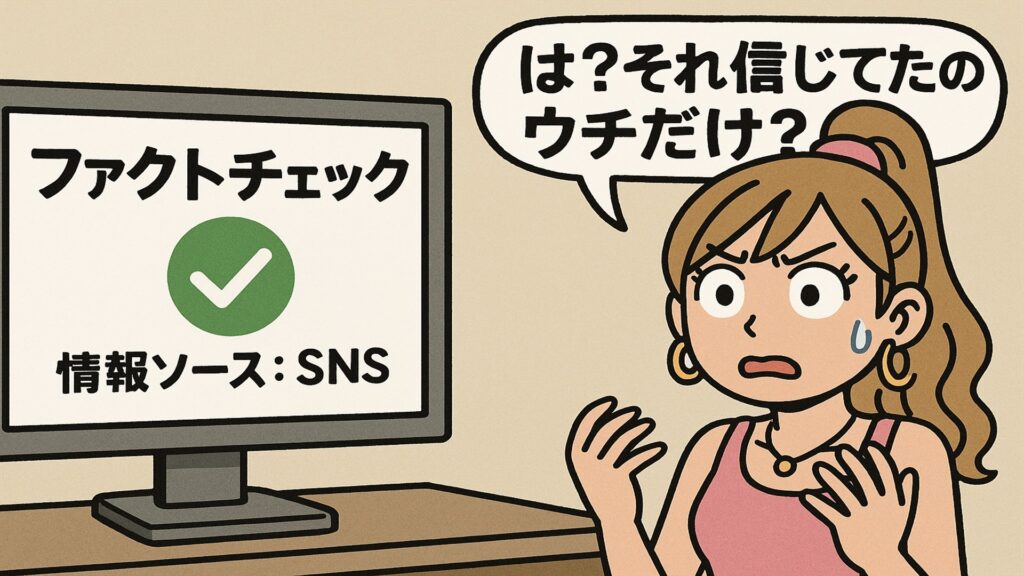

だからこそ、次の4つは絶対に守りましょう。

- 情報のソースがSNSだけなら、まず疑う

- 一次資料(政府発表・公式文書)を確認する

- 理解できない内容は投稿しない

- AIの文章は必ず自分でファクトチェックする

たったこれだけで、デマ拡散のほとんどは防げます。投稿前のわずかな確認が、自分と周りの人を守る大事な一歩になります。

特に自分が理解していない文章を公開するようなことは絶対にやめた方が良いでしょう。